視点位置を考慮したDepth Fused 3D画像のリアルタイム生成法

あらまし

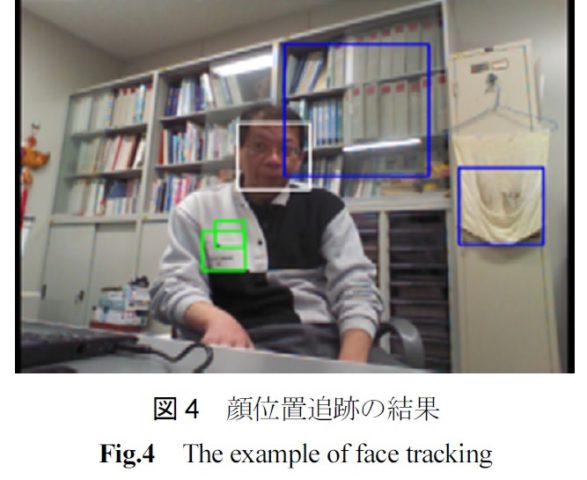

観察者から見て異なる視距離に置かれた2枚のディスプレイ上の対応する位置に物体を表示する.その際に,2枚のディスプレイ間の表示輝度比に対応した位置に物体像を知覚する.この立体錯視をDepth Fused 3D錯視と呼ぶ.この錯視現象を利用した3Dディスプレイ(Depth Fused 3D Display)用の立体画像をリアルタイム生成する方法について検討したので報告する.本研究ではカメラと物体までの距離を安価で簡便に測定できるKINECTを距離情報取得用デバイスとして用いた.また,Depth Fused 3D錯視による立体像が良好に知覚されるためには,前後の画像が観察者の顔位置から重なって表示されることが必要である.本研究では,Haar-like特徴と学習結果,肌色画素の割合と顔候補領域の大きさを用いることで観察者の顔位置を良好に追跡し,顔位置をもとに前後画像の位置を補正する方法を示した.

著者

田村徹 平野寿宗

東京工芸大学大学院工学研究科メディア工学専攻